Wenn Sie Wert darauf legen, ein Standbild in eine glaubwürdige Bewegung zu verwandeln, ist Happy Horse AI derzeit eine der stärksten öffentlichen Optionen. Auf der aktuellen Artificial Analysis Image-to-Video-Bestenliste belegt HappyHorse-1.0 den ersten Platz in der Hauptansicht ohne Audio mit einem Elo von 1.415. Das ist der Hauptgrund, warum dieser Workflow im Jahr 2026 wichtig ist: Image-to-Video ist keine Nebenfunktion mehr. Es ist eine der deutlichsten Stärken von Happy Horse.

Wir haben tryhappyhorseai.com um Happy Horse-Workflows herum aufgebaut, einschließlich Prompt-First-Generierung und Referenzbild-Animation. Das bedeutet, dass dieser Leitfaden nicht nur eine neu formulierte Feature-Seite ist. Er basiert auf den gleichen Arten von Porträt-, Produkt- und Kinotests, die wir verwenden, um zu entscheiden, ob ein Modell für Kreative und Teams tatsächlich nutzbar ist.

Die Kurzversion ist einfach: Happy Horse AI Image-to-Video funktioniert am besten, wenn das Quellbild bereits eine klare Subjektidentität, Lichtrichtung und Tiefenhinweise enthält. Wenn das Referenzbild stark ist, ist das Modell sehr gut darin, das Aussehen zu erhalten und gleichzeitig Bewegung hinzuzufügen. Wenn das Referenzbild schwach, flach oder kompositorisch unübersichtlich ist, kann kein Prompting es vollständig retten.

Das schnelle Urteil

Happy Horse AI ist derzeit das beste öffentliche Image-to-Video-Modell für allgemeinen Realismus. Es führt die Haupt-Bestenliste an, verarbeitet Porträts besonders gut und ist stark darin, Standbilder von Produkten oder Lifestyle-Szenen in kohärente Kurzclips zu verwandeln.

Das bedeutet nicht, dass es jeden Image-to-Video-Unterfall gewinnt. Die Nuance ist wichtig:

- auf der Standard-Bestenliste ohne Audio führt Happy Horse das Feld an

- in der Audio-fähigen Image-to-Video-Ansicht hat Seedance 2.0 einen knappen öffentlichen Vorsprung

- in unseren Tests fühlte sich Happy Horse immer noch als die sicherere Gesamtwahl für Wiedergabetreue und Bewegungsrealismus an

Wenn Ihr Workflow also mit einem Standbild beginnt und Ihre oberste Priorität glaubwürdige Bewegung ist, ist Happy Horse immer noch das Modell, das wir zuerst testen würden.

Worin Happy Horse AI Image to Video gut ist

Image-to-Video ist eine dieser Kategorien, in denen viele Tools in Demos beeindruckend aussehen, aber im echten Einsatz schnell versagen. Die typischen Fehlermodi sind bekannt:

- das Gesicht ähnelt nicht mehr dem Quellbild

- der Hintergrund verschiebt sich zu stark zwischen den Frames

- die Bewegung wirkt generisch statt szenenspezifisch

- Kamerabewegung wird hinzugefügt, aber die Szene fühlt sich nicht mehr an das ursprüngliche Standbild gebunden an

Happy Horse vermeidet diese Fehler in der Regel besser als die meisten anderen.

In der Praxis sind die stärksten Anwendungsfälle:

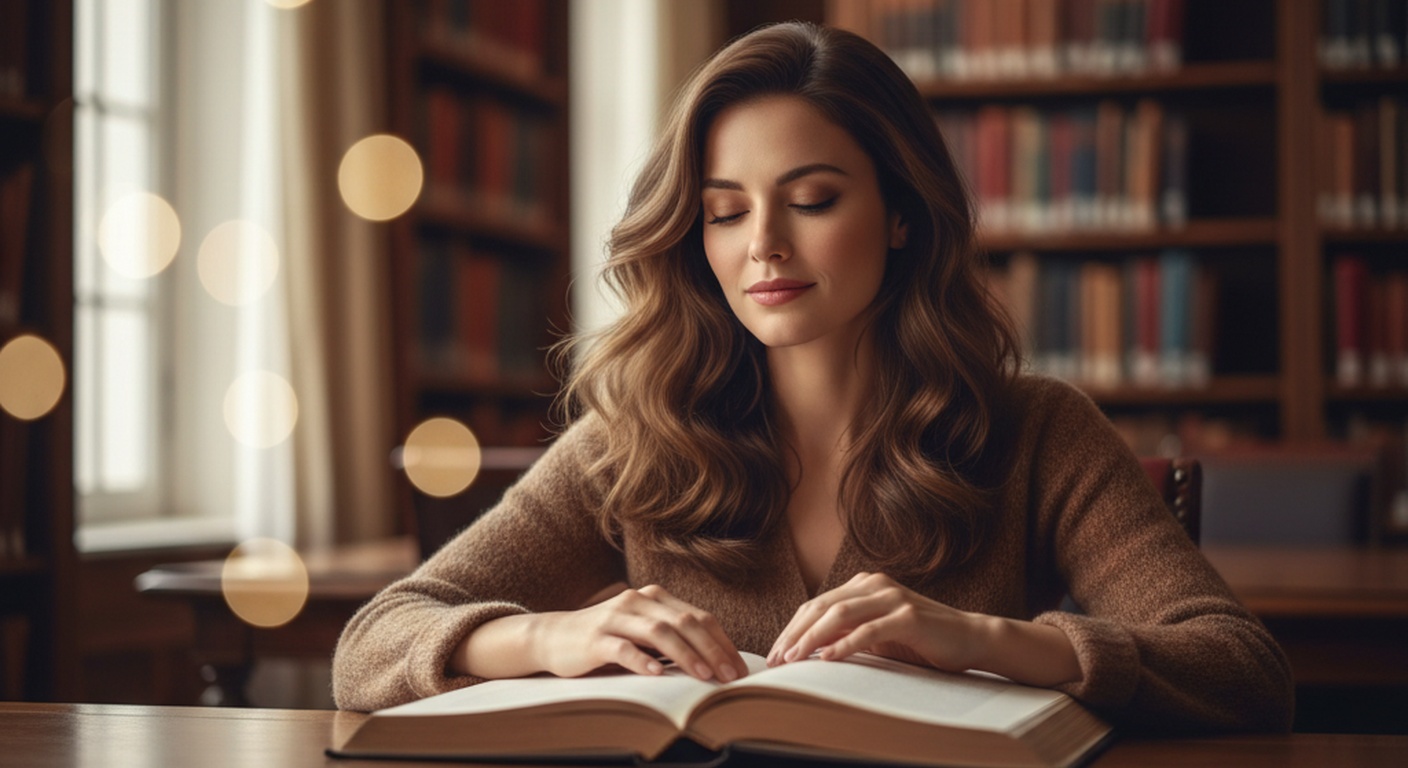

1. Porträt-Animation

Dies ist wahrscheinlich die sauberste Kategorie für Happy Horse Image-to-Video. Wenn das Eingabebild bereits natürliches Licht, gute Sichtbarkeit des Gesichts und eine klare Subjektrahmung aufweist, neigt das Modell dazu, die Identität gut zu erhalten, während es subtile Augen-, Kopf- und Haarbewegungen hinzufügt.

Wir haben dafür einen guten internen Benchmark aus der bestehenden Bibliotheksporträt-Demo in unserem Showcase-Set. Diese Art von Bild funktioniert, weil es dem Modell bereits Folgendes bietet:

- saubere Subjekttrennung

- sanfte Tiefenhinweise im Hintergrund

- realistische Lichtrichtung

- ein natürliches Ziel für kleine Gesichtsbewegungen statt extremer Action

Wenn Ihr Anwendungsfall Creator-Intros, Profilbilder, Sprecher-Loops oder Modeporträts sind, fühlt sich Happy Horse hier besonders stark an.

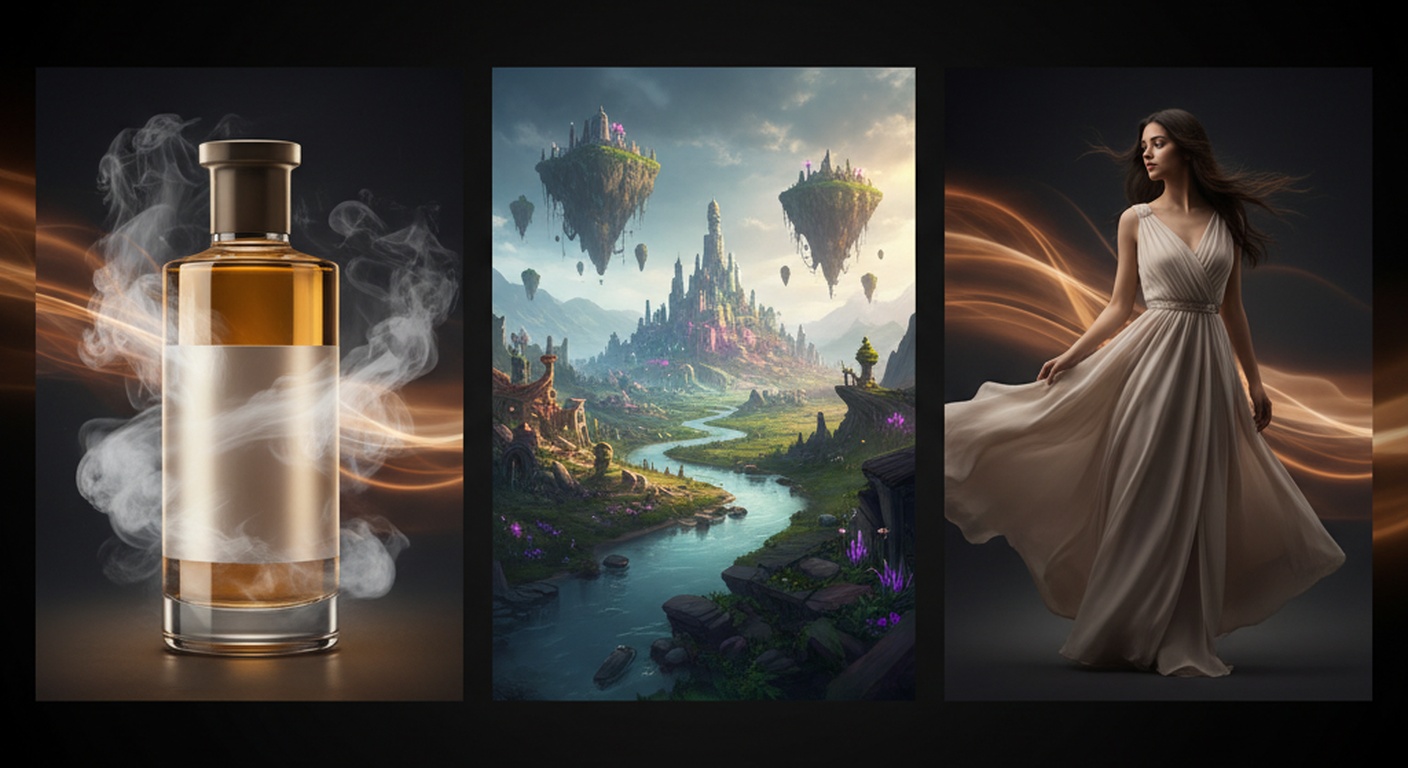

2. Produktbewegung

Standbild-Produktfotografie ist ein weiterer starker Anwendungsfall. Flaschen, Uhren, Kosmetika, Laptops und angerichtete Speisen funktionieren alle gut, wenn der Prompt eine zurückhaltende Bewegung statt einer dramatischen Transformation fordert. Gute Beispiele sind:

- eine Parfümflasche mit aufsteigendem Nebel

- eine Kaffeetasse mit aufsteigendem Dampf

- ein Zifferblatt, das bei einer langsamen Kamerabewegung Licht einfängt

- eine Kosmetikverpackung, die sich mit minimaler Handinteraktion öffnet

Der Trick ist, dass Happy Horse besser funktioniert, wenn die Bewegung natürlich aus der bereits vorhandenen Szene entsteht. Wenn man ein statisches Produktbild bittet, plötzlich eine komplexe Actionszene zu werden, schwächt das in der Regel die Wiedergabetreue.

3. Filmische Standbilder

Wenn Sie von einem filmischen Frame, Landschafts-Concept-Art oder einer sorgfältig komponierten Standbildszene ausgehen, ist Happy Horse gut darin, Folgendes hinzuzufügen:

- langsame Kamerafahrten nach vorne (Push-ins)

- Umgebungsbewegung

- Atmosphäre wie Rauch, Nebel, Regen oder Partikel

- subtile Subjektbewegung, die die ursprüngliche Komposition intakt lässt

Hier wird Image-to-Video besonders nützlich für Trailer, Mood-Videos und Konzeptpräsentationen.

Benchmarks: Wo Happy Horse aktuell steht

Stand 26. April 2026 ist die Artificial Analysis Image-to-Video-Bestenliste immer noch der beste öffentliche Referenzpunkt.

Haupt-Image-to-Video-Bestenliste

| Modell | I2V Elo | Audio-Ansicht | Aktuelle Einschätzung |

|---|---|---|---|

| HappyHorse-1.0 | 1.415 | 1.163 | Stärkstes öffentliches Realismus-Signal insgesamt |

| Dreamina Seedance 2.0 720p | 1.358 | 1.164 | Leichter Vorsprung bei Audio-Aktivierung |

| Kling 3.0 | ~1.279 | niedrigeres öffentliches Signal | Bessere Produktransparenz als reine I2V-Stärke |

Die wichtigste Erkenntnis ist nicht subtil: Auf der Image-to-Video-Bestenliste ohne Audio liegt Happy Horse klar vorne.

Die einzige Nuance, die hervorzuheben ist, betrifft die Audio-aktivierte Unteransicht. Dort hat Seedance 2.0 einen 1-Punkt öffentlichen Vorsprung vor Happy Horse. Das ist wichtig, wenn Ihr genauer Workflow von audio-sensibler Bildanimation abhängt, ändert aber nichts an der allgemeineren Aussage, dass Happy Horse der stärkere Allround-I2V-Performer ist.

Deshalb trennen wir die Empfehlung wie folgt:

- bestes Allzweck-Image-to-Video-Modell: Happy Horse 1.0

- bestes Image-to-Video-Modell, wenn audio-sensible multimodale Steuerung der Kernpunkt ist: engere Entscheidung, testen Sie auch Seedance

Wenn Sie diesen engeren Vergleich wünschen, lesen Sie danach Happy Horse 1.0 vs Seedance 2.0.

Wie man bessere Ergebnisse mit Happy Horse Image-to-Video erzielt

Das Referenzbild ist hier wichtiger als der Prompt. Bei Text-to-Video trägt der Prompt die meiste Last. Bei Image-to-Video leistet das Bild die Hälfte der Anweisungsarbeit, bevor die Generierung überhaupt beginnt.

Dies sind die bewährten Praktiken, die sich in unseren Tests bewährt haben:

Beginnen Sie mit einem sauberen Quellbild

Ihr Quellbild sollte bereits Folgendes aufweisen:

- ein klares Subjekt

- eine lesbare Lichtrichtung

- einen starken Fokus auf das wichtige visuelle Element

- minimale kompositorische Unordnung

Wenn das Bild flach, überkomprimiert oder visuell verrauscht ist, fühlt sich die generierte Bewegung normalerweise weniger stabil an.

Fragen Sie nach Bewegung, die zum Bild passt

Dies ist einer der einfachsten Fehler, die man machen kann. Wenn das Bild ein sitzendes Porträt zeigt, fragen Sie nach subtiler Kopfbewegung, Blinzeln, Atmen und sanftem Kameradrift. Wenn es eine Flasche auf einem reflektierenden Tisch zeigt, fragen Sie nach Nebel, einem sanften Lichtstrahl und langsamer Rotation. Wenn es eine Fantasielandschaft zeigt, fragen Sie nach Nebel, Wolken, Partikeln und einem sanften Push-in.

Je näher die Bewegungsanfrage zur ursprünglichen visuellen Logik passt, desto glaubwürdiger ist das Ergebnis in der Regel.

Verwenden Sie Kamerasprache sparsam

Bei Image-to-Video ist weniger oft mehr. Ein Standbild legt die Komposition bereits fest. Wenn Sie den Prompt mit dramatischen Kamerabefehlen überladen, kann das Modell überkorrigieren und vom Quellbild abweichen.

In den meisten erfolgreichen Durchläufen funktionierten Prompts wie diese besser:

subtiler Push-inlangsamer filmischer Driftsanfte Kopfbewegungleichter Wind im HaarNebel steigt auf

Diese funktionierten schlechter:

schnelle Orbitaufnahmeextremer Dolly-Zoomheftiger Aktionsausbruchschnelle handgeführte Whip-Pan

Fügen Sie Umgebungsbewegung vor Körperbewegung hinzu

Wenn Sie entscheiden müssen, wo Sie Ihr Bewegungsbudget einsetzen, beginnen Sie mit der Szene. Haarwellen, Dampf, Nebel, Stoff, Reflexionen und Partikel lassen einen Clip oft zuverlässiger lebendig wirken als ambitionierte Ganzkörperbewegungen aus einer statischen Eingabe.

Das gilt besonders für kommerzielle oder redaktionelle Anwendungsfälle, wo subtile Bewegung in der Regel hochwertiger aussieht als übertriebene Bewegung.

Beispiel-Workflows, die tatsächlich sinnvoll sind

Hier sind drei Image-to-Video-Workflows, die unserer Meinung nach tatsächlich nützlich sind, anstatt nur demo-freundlich zu sein.

Porträt-zu-Video-Loop

Eingabe:

- ein sauberes Porträt mit weicher Hintergrundtiefe

Prompt-Richtung:

- subtiles Blinzeln

- natürliche Kopfbewegung

- leichte Haarbewegung

- langsamer filmischer Push-in

Am besten geeignet für:

- Creator-Biografien

- Wartelisten-Seiten

- Landingpage-Hero-Loops

- persönliche Marken-Intros

Produkt-Standbild zu Werbebewegung

Eingabe:

- gut beleuchtetes Produktfoto auf einer sauberen Oberfläche

Prompt-Richtung:

- aufsteigender Dampf, Nebel oder Staub

- sanfte Reflexionsänderung

- langsame Rotation oder Kamerabewegung

- hochwertige Studiobeleuchtungs-Kontinuität

Am besten geeignet für:

- Beauty-Marken

- Kaffee- und Lebensmittel-Content

- DTC-Produktseiten

- Social-Promo-Loops

Concept Art zu filmischer Szene

Eingabe:

- ein starkes Standbild mit geschichteter Tiefe und Atmosphäre

Prompt-Richtung:

- Wolken- oder Nebelbewegung

- sanfter Dolly-in

- kleine Umgebungsanimation

- Partikel, Lichtstrahlen oder Wasserbewegung

Am besten geeignet für:

- Trailer

- visuelle Entwicklung

- Game-Pitch-Decks

- kreative Treatment-Videos

Dies sind die Arten von Fällen, in denen Image-to-Video einen echten Mehrwert bietet. Sie ersetzen nicht die vollständige Videoproduktion. Sie werten ein Standbild in Bewegung auf, ohne bei Null anfangen zu müssen.

Wie Happy Horse im Vergleich zu Text-to-Video für diese Aufgabe abschneidet

Ein häufiger Fehler ist die Wahl von Text-to-Video, wenn Image-to-Video tatsächlich kontrollierbarer wäre.

Verwenden Sie Image-to-Video, wenn:

- Sie bereits das genaue Charakter-Aussehen haben

- Marken-/Produkt-Wiedergabetreue wichtig ist

- die Komposition nah an einer Referenz bleiben muss

- das Ziel die Bewegungsverbesserung ist, nicht die Szenenerfindung

Verwenden Sie Text-to-Video, wenn:

- Sie die Szene von Grund auf neu erfinden müssen

- Sie schnell verschiedene Richtungen erkunden

- die Identitätskonsistenz weniger wichtig ist als die Konzeptfindung

- die Bewegung selbst wichtiger ist als die Bewahrung eines Quellframes

Diese Unterscheidung ist wichtig, da viele Kreative das Modell beschuldigen, wenn das eigentliche Problem die Wahl des falschen Modus ist.

Wenn Sie noch lernen, wie Sie das Modell von Grund auf steuern, ist 50 Happy Horse AI Prompts, die tatsächlich funktionieren die beste Ergänzung zu diesem Artikel.

Sollten Sie Happy Horse AI Image-to-Video verwenden?

Wählen Sie es, wenn:

- Sie den stärksten öffentlichen Image-to-Video-Benchmark-Führer wollen

- Sie mit Porträts, Produkten oder filmischen Standbildern arbeiten

- Ihnen Realismus wichtiger ist als Stilisierung

- Sie ein Modell wünschen, das auch Text-to-Video- und native Audio-Workflows verarbeiten kann

Seien Sie vorsichtiger, wenn:

- Ihr gesamter Workflow von audio-aktivierter Bildanimation und multimodaler Steuerung abhängt

- Sie heute eine vollständig selbstbedienbare öffentliche API benötigen

- Ihre Referenzbilder schwach, verrauscht oder kompositorisch unklar sind

Unsere Empfehlung

Für die meisten Kreativen, Agenturen und Produktteams ist Happy Horse AI derzeit das beste Image-to-Video-Modell für den Einstieg.

Es führt den wichtigsten öffentlichen Benchmark an. Es verhält sich gut bei Porträt- und Produktreferenzen. Und es bietet eine praktische Brücke zwischen Standbild-Assets und kurzen filmischen Clips, ohne einen vollständigen Videoproduktions-Workflow zu erzwingen.

Wenn Sie jetzt mit der Generierung beginnen möchten, nutzen Sie dieses Bild-zu-Video KI-Tool — es ist live und für jeden zugänglich. Wenn Sie zuerst einen umfassenderen Modellüberblick wünschen, lesen Sie Was ist Happy Horse AI? als Nächstes.

FAQ

Was ist Happy Horse AI Image-to-Video?

Happy Horse AI Image-to-Video ist der Workflow des Modells, um ein stilles Referenzbild in einen kurzen animierten Clip zu verwandeln, wobei das Subjekt, die Beleuchtung und die Gesamtkomposition des Originalbildes erhalten bleiben.

Ist Happy Horse das beste Image-to-Video-Modell?

Auf der aktuellen öffentlichen Artificial Analysis Image-to-Video-Bestenliste ohne Audio, ja. HappyHorse-1.0 belegt am 26. April 2026 den ersten Platz mit einem Elo von 1.415.

Ist Happy Horse besser als Seedance für Image-to-Video?

Insgesamt ja, auf der Haupt-Bestenliste ohne Audio. Seedance 2.0 hat einen knappen öffentlichen Vorsprung in der Audio-aktivierten Image-to-Video-Unteransicht, daher ist dieser spezifische Workflow wettbewerbsfähiger.

Welche Arten von Bildern funktionieren am besten?

Klare Porträts, Produkt-Standbilder und filmische Szenen mit guter Beleuchtung und Tiefenhinweisen funktionieren am besten. Unübersichtliche, flache oder minderwertige Bilder erzeugen in der Regel schwächere Bewegungen.

Ist Image-to-Video besser als Text-to-Video?

Nicht immer. Image-to-Video ist besser, wenn die Wiedergabetreue zu einem spezifischen Quellframe wichtig ist. Text-to-Video ist besser, wenn das Modell die Szene von Grund auf neu erfinden soll.

Empfohlene Lektüre

- Was ist Happy Horse AI? Der #1 Rangierte KI-Video-Generator erklärt

- Happy Horse 1.0 vs Seedance 2.0: Welches Videomodell gewinnt?

- Happy Horse 1.0 vs Kling 3.0: Welches Videomodell gewinnt?

- 50 Happy Horse AI Prompts, die tatsächlich funktionieren