静止画を説得力のある動画に変換することに関心があるなら、Happy Horse AI は現在利用可能な最も強力なパブリックオプションの1つです。現在のArtificial Analysis image-to-videoリーダーボードで、HappyHorse-1.0はメインの音声なしビューでElo 1,415を記録し、1位にランクインしています。これこそが、このワークフローが2026年に重要である主要な理由です。image-to-videoはもはや付帯機能ではありません。それはHappy Horseの最も明確な強みの一つです。

私たちは、プロンプト先行の生成や参照画像アニメーションを含むHappy Horseのワークフローを中心にtryhappyhorseai.comを構築してきました。つまり、このガイドは単なる機能ページを言い換えたものではありません。クリエイターやチームにとってモデルが実際に使用可能かどうかを判断する際に私たちが使用する、ポートレート、製品、シネマティックなテストと同じ種類のテストに基づいています。

簡潔に言えばシンプルです。Happy Horse AI image to videoは、ソース画像に明確な被写体のアイデンティティ、照明の方向、奥行きの手がかりがすでに含まれている場合に最も効果を発揮します。 参照画像が強力であれば、モデルは外観を保持しつつ動きを加えるのが非常に得意です。参照画像が弱かったり、平坦だったり、構図が乱れていたりする場合、どんなにプロンプトを工夫しても完全に救うことはできません。

早わかり評価

Happy Horse AIは、現在、汎用リアリズムにおいて最高のパブリックimage-to-videoモデルです。 主要なパブリックリーダーボードをリードし、ポートレートを特にうまく処理し、静止した製品やライフスタイルのフレームをまとまりのある短いクリップに変換するのに優れています。

だからといって、あらゆるimage-to-videoのサブケースで勝利するわけではありません。そのニュアンスは重要です。

- 標準の音声なしリーダーボードでは、Happy Horseが他をリードしています。

- 音声対応のimage-to-videoビューでは、Seedance 2.0がわずかにリードしています。

- 私たちのテストでは、Happy Horseは忠実度と動きのリアリズムにおいて、依然として全体的に安全な選択肢であると感じられました。

したがって、ワークフローが静止画から始まり、最も優先すべき事項が説得力のある動きである場合、Happy Horseは私たちが最初にテストするモデルとなるでしょう。

Happy Horse AI Image to Videoが得意なこと

image-to-videoは、多くのツールがデモでは印象的に見えるものの、実際に使用するとすぐに破綻してしまうカテゴリの1つです。典型的な失敗パターンはおなじみです。

- 顔がソース画像に似ていなくなる

- 背景がフレーム間で大きく変化する

- 動きがシーン固有のものではなく、汎用的に感じられる

- カメラの動きが追加されるが、シーンが元の静止画に固定されているように感じられなくなる

Happy Horseは、これらの失敗を他のほとんどのモデルよりも上手く回避します。

実際には、最も強力なユースケースは次のとおりです。

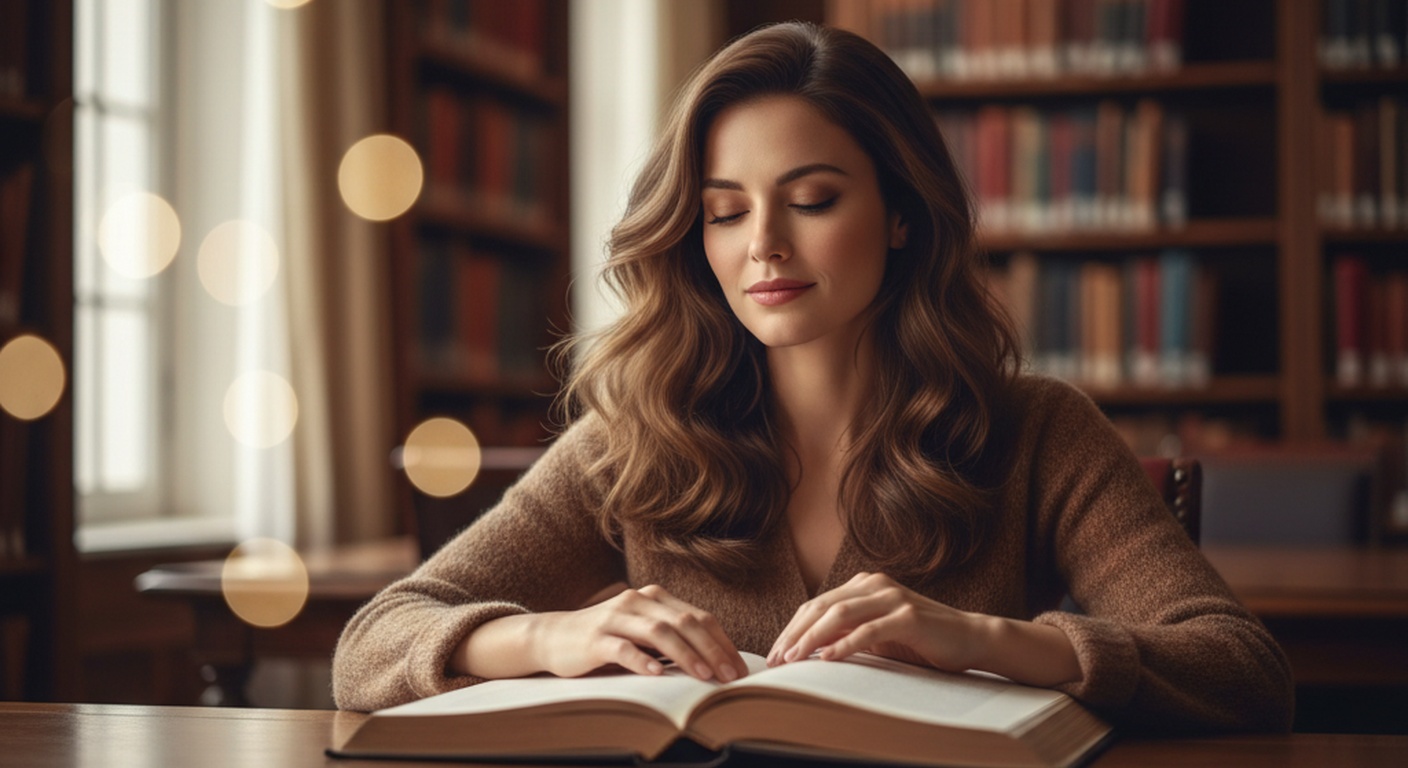

1. ポートレートアニメーション

これはおそらく、Happy Horse image to videoにとって最もクリーンなカテゴリです。入力画像にすでに自然な光、良好な顔の視認性、明確な被写体フレーミングがある場合、モデルは微妙な目、頭、髪の動きを加えながら、アイデンティティをうまく維持する傾向があります。

私たちは、ショーケースセットの既存のライブラリポートレートデモから、このための優れた内部ベンチマークを持っています。このタイプの画像がうまく機能するのは、モデルに以下の情報がすでに与えられているためです。

- 被写体がきれいに分離されていること

- 背景に柔らかな奥行きのヒントがあること

- 現実的な照明の方向

- 極端なアクションではなく、小さな顔の動きに対する自然な目標

クリエイターのイントロ、プロフィール画像、広報担当者のループ、ファッションポートレートなどがあなたのユースケースであれば、Happy Horseは特に強力だと感じるでしょう。

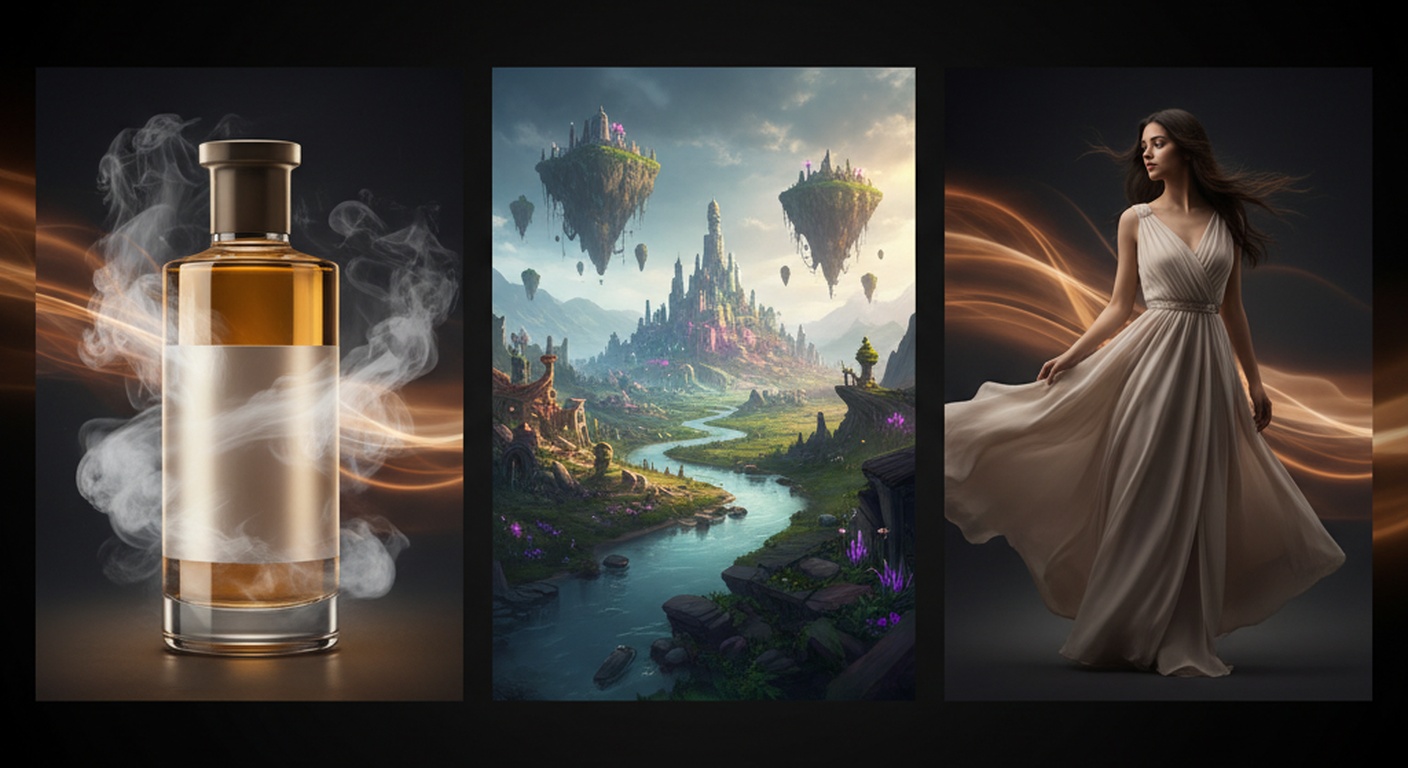

2. 製品の動き

静止した製品写真ももう一つの強力な組み合わせです。ボトル、時計、化粧品、ラップトップ、盛り付けられた食品はすべて、劇的な変換ではなく、抑制された動きをプロンプトで要求した場合にうまく機能します。良い例としては、次のものがあります。

- ミストが漂う香水ボトル

- 蒸気が立ち上るコーヒーマグ

- カメラのゆっくりとした動きの中で光を捉える時計の文字盤

- 最小限の手の動きで開く化粧品のパッケージ

ポイントは、Happy Horseはすでに存在するシーンから動きが自然に生じるときに、より優れたパフォーマンスを発揮するということです。静止した製品画像に突然複雑なアクションシーンになるように要求すると、通常は忠実度が低下します。

3. シネマティックな静止画

シネマティックなフレーム、風景のコンセプトアート、または慎重に構成された静止シーンから始める場合、Happy Horseは次の要素を追加するのに優れています。

- ゆっくりとしたプッシュイン

- 環境の動き

- 煙、霧、雨、粒子などの雰囲気

- 元の構図を保つ微妙な被写体の動き

これは、image-to-videoが予告編、ムードビデオ、コンセプトプレゼンテーションに特に役立つところです。

ベンチマーク: Happy Horseの現状

2026年4月26日現在、Artificial Analysis image-to-videoリーダーボードが依然として最高の公開参照点です。

メインのimage-to-videoリーダーボード

| モデル | I2V Elo | 音声ビュー | 現在の評価 |

|---|---|---|---|

| HappyHorse-1.0 | 1,415 | 1,163 | 全体的に最も強力なパブリックリアリズム信号 |

| Dreamina Seedance 2.0 720p | 1,358 | 1,164 | わずかに音声対応で優位 |

| Kling 3.0 | ~1,279 | パブリック信号は低め | 純粋なI2Vの強さよりも製品の透明性が優れている |

主要な結論は明白です。音声なしのimage-to-videoリーダーボードでは、Happy Horseが明確にリードしています。

唯一強調すべきニュアンスは、音声対応サブビューです。そこでは、Seedance 2.0がHappy Horseに対して1ポイントのわずかな差でリードしています。これは、正確なワークフローが音声対応の画像アニメーションに依存する場合に重要ですが、Happy Horseがより強力なオールラウンドなパブリックI2Vパフォーマーであるという広範な話を変えるものではありません。

これが、私たちが推奨をこのように区別する理由です。

- 最高の汎用image-to-videoモデル: Happy Horse 1.0

- 音声対応のマルチモーダル制御が最重要事項である場合の最高のimage-to-videoモデル: より僅差で、Seedanceもテストすべき

より詳細な比較が必要な場合は、この後でHappy Horse 1.0 vs Seedance 2.0をお読みください。

Happy Horse Image to Videoからより良い結果を得る方法

ここでは、プロンプトよりも参照画像が重要です。text-to-videoの場合、プロンプトがほとんどの役割を担います。image-to-videoの場合、生成が始まる前に画像が指示作業の半分を行っています。

私たちのテストで有効だったベストプラクティスは次のとおりです。

クリーンなソース画像から始める

ソース画像にはすでに以下のものが含まれている必要があります。

- 1つの明確な被写体

- 読みやすい照明の方向

- 重要な視覚要素に強いフォーカス

- 構図上の最小限の乱雑さ

画像が平坦、過度に圧縮、または視覚的にノイズが多い場合、生成される動きは通常、安定性に欠けます。

画像に合った動きを要求する

これは最も犯しやすい間違いの一つです。画像が座ったポートレートを示している場合、微妙な頭の動き、まばたき、呼吸、そして浅いカメラのドリフトを要求します。反射するテーブルの上のボトルを示している場合、ミスト、光の掃引、ゆっくりとした回転を要求します。ファンタジーの風景を示している場合、霧、雲、粒子、そして穏やかなプッシュインを要求します。

動きの要求が元の視覚的なロジックに近ければ近いほど、結果はより説得力のあるものになる傾向があります。

カメラの言語は控えめに使用する

image-to-videoでは、少ないほど良いことが多いです。静止画はすでに構図を設定しています。プロンプトに劇的なカメラコマンドを過剰に詰め込むと、モデルが過剰に補正し、ソースフレームから離れてしまう可能性があります。

成功した多くの実行では、次のようなプロンプトの方が効果がありました。

微妙なプッシュインゆっくりとしたシネマティックなドリフト穏やかな頭の動き髪に軽く風がなびく霧が立ち上る

これらは効果が薄かったです。

急速なオービットショット極端なドリーズーム激しいアクションの爆発素早い手持ちのウィップパン

身体の動きの前に環境の動きを追加する

動きの予算をどこに使うかを選択する必要がある場合、シーンから始めましょう。髪の揺れ、蒸気、霧、布、反射、粒子などは、静的な入力からの野心的な全身の動きよりも、クリップに生命感を与える効果が信頼できることが多いです。

これは特に商業用途や編集用途の場合に当てはまり、微妙な動きの方が誇張された動きよりも高級感があるように見えることが多いです。

実際に意味のあるワークフロー例

ここでは、デモ向きなだけでなく、実際に役立つと考える3つのimage-to-videoワークフローを紹介します。

ポートレートからビデオへのループ

入力:

- 背景に柔らかな奥行きのあるクリーンなポートレート

プロンプトの方向性:

- 微妙な瞬き

- 自然な頭の動き

- 軽い髪の動き

- ゆっくりとしたシネマティックなプッシュイン

最適用途:

- クリエイターのプロフィール

- 待機リストページ

- ランディングページのヒーローループ

- パーソナルブランドのイントロ

製品の静止画から広告動画へ

入力:

- きれいな表面に置かれた、よく照明された製品写真

プロンプトの方向性:

- 漂う蒸気、ミスト、または埃

- 柔らかな反射の変化

- ゆっくりとした回転またはカメラの動き

- プレミアムなスタジオ照明の継続性

最適用途:

- 美容ブランド

- コーヒーおよび食品コンテンツ

- DTC製品ページ

- ソーシャルプロモーションループ

コンセプトアートからシネマティックシーンへ

入力:

- 重層的な奥行きと雰囲気のある強力な静止画

プロンプトの方向性:

- 雲や霧の動き

- 穏やかなドリーイン

- 小さな環境アニメーション

- 粒子、光線、または水の動き

最適用途:

- 予告編

- ビジュアル開発

- ゲームのピッチデッキ

- クリエイティブなトリートメントビデオ

これらは、image-to-videoが真のレバレッジを発揮する種類のケースです。あなたは完全なビデオ制作を置き換えるわけではありません。静止画アセットをゼロから始めることなく、動画にアップグレードしているのです。

Happy HorseとText-to-Videoの比較(この作業の場合)

よくある間違いは、image-to-videoの方が実際には制御しやすいのにtext-to-videoを選択してしまうことです。

image-to-videoを使用する場合:

- すでに正確なキャラクターの外観がある場合

- ブランド/製品の忠実度が重要な場合

- 構図が参照に忠実である必要がある場合

- 目標がシーンの考案ではなく、動きの強化である場合

text-to-videoを使用する場合:

- シーンをゼロから考案する必要がある場合

- 大まかな方向性を素早く探索している場合

- アイデンティティの一貫性よりもコンセプトの発見が重要な場合

- 動き自体がソースフレームの保持よりも重要な場合

多くのクリエイターが、真の問題が間違ったモードを選択したことであるにもかかわらず、モデルを非難するため、この区別は重要です。

モデルをゼロから操縦する方法をまだ学んでいる段階であれば、実際に機能する50のHappy Horse AIプロンプトがこの記事の最高の補完資料となるでしょう。

Happy Horse AI Image to Videoを使用すべきか?

次の場合に選択する:

- 最も強力なパブリックimage-to-videoベンチマークリーダーを望む場合

- ポートレート、製品、またはシネマティックな静止画から作業する場合

- スタイリゼーションよりもリアリズムを重視する場合

- text-to-videoやネイティブオーディオワークフローも処理できる1つのモデルを望む場合

次の場合により慎重になる:

- ワークフロー全体が音声対応の画像アニメーションとマルチモーダル制御に依存している場合

- 今すぐ完全にセルフサービスのパブリックAPIが必要な場合

- 参照画像が弱い、ノイズが多い、または構図が混乱している場合

私たちの推奨

ほとんどのクリエイター、エージェンシー、および製品チームにとって、Happy Horse AIは現時点で開始すべき最高のimage-to-videoモデルです。

主要なパブリックベンチマークをリードしています。ポートレートや製品の参照に対して適切に動作します。そして、静止アセットと短いシネマティッククリップとの間の実用的な橋渡しとなり、完全なビデオ制作ワークフローを強制することはありません。

今すぐ生成を開始したい場合は、この画像から動画を生成するAIツールをご利用ください — ライブ公開されており、誰でも利用できます。まず、より広範なモデルの概要を知りたい場合は、次に、What Is Happy Horse AI?をお読みください。

FAQ

Happy Horse AI image to videoとは何ですか?

Happy Horse AI image to videoは、静止した参照画像を、元の画像の被写体、照明、全体的な構図を維持しながら短いアニメーションクリップに変換するモデルのワークフローです。

Happy Horseは最高のimage-to-videoモデルですか?

現在のパブリックなArtificial Analysisの音声なしimage-to-videoリーダーボードでは、はい、そうです。2026年4月26日現在、HappyHorse-1.0はElo 1,415で1位にランクインしています。

Happy Horseはimage-to-videoにおいてSeedanceよりも優れていますか?

全体的には、メインの音声なしリーダーボードでは優れています。Seedance 2.0は音声対応のimage-to-videoサブビューでわずかにリードしているため、その特定のワークフローではより競合的です。

どのような種類の画像が最適に機能しますか?

良好な照明と奥行きのヒントを持つ、明確なポートレート、製品の静止画、およびシネマティックなシーンが最もよく機能します。乱雑な、平坦な、または低品質の画像は通常、弱い動きを生み出します。

image-to-videoはtext-to-videoよりも優れていますか?

常にそうとは限りません。特定のソースフレームへの忠実度が重要な場合、image-to-videoの方が優れています。モデルにシーンをゼロから考案させる必要がある場合、text-to-videoの方が優れています。

おすすめの読書

- Happy Horse AIとは何か? #1にランク付けされたAI動画生成ツールを解説

- Happy Horse 1.0 vs Seedance 2.0: どちらの動画モデルが勝つか?

- Happy Horse 1.0 vs Kling 3.0: どちらの動画モデルが勝つか?

- 実際に機能する50のHappy Horse AIプロンプト